Tether เปิดตัว Framework BitNet LoRA ข้ามแพลตฟอร์ม รองรับการฝึกฝนและประมวลผล AI พารามิเตอร์หลายพันล้านบนอุปกรณ์ผู้บริโภค

ผู้ออก stablecoin USDT อย่าง Tether ประกาศเปิดตัวสิ่งที่บริษัทอธิบายว่าเป็น cross-platform LoRA fine-tuning framework แห่งแรกที่ออกแบบมาสำหรับโมเดล Microsoft BitNet ซึ่งอิงจากสถาปัตยกรรมโมเดลภาษาขนาดใหญ่แบบ 1-bit ความสามารถนี้ถูกรวมเข้ากับระบบ QVAC Fabric และมีรายงานว่าช่วยลดการใช้หน่วยความจำและความต้องการในการคำนวณอย่างมีนัยสำคัญ ตามที่บริษัทระบุ การพัฒนานี้ช่วยให้โมเดลภาษาขนาดใหญ่ รวมถึงโมเดลที่มีพารามิเตอร์หลายพันล้านตัว สามารถปรับแต่งได้โดยใช้ฮาร์ดแวร์ผู้บริโภคที่หาได้ทั่วไป เช่น แล็ปท็อป หน่วยประมวลผลกราฟิกมาตรฐาน และสมาร์ทโฟนรุ่นใหม่

การพัฒนาและการบำรุงรักษาระบบปัญญาประดิษฐ์ได้ต้องการฮาร์ดแวร์ระดับองค์กรแบบดั้งเดิม โดยเฉพาะโครงสร้างพื้นฐาน NVIDIA เฉพาะทางหรือสภาพแวดล้อมบนคลาวด์ ข้อกำหนดเหล่านี้มีส่วนทำให้ต้นทุนการดำเนินงานสูง จำกัดการเข้าถึงการพัฒนา AI ขั้นสูงเฉพาะองค์กรขนาดใหญ่ที่มีทรัพยากรทางการเงินจำนวนมากและเข้าถึงระบบคอมพิวเตอร์เฉพาะทางได้

Tether กล่าวว่าโมเดลภาษาขนาดใหญ่ QVAC Fabric ของบริษัท ซึ่งได้รับการปรับปรุงด้วย framework ที่ใช้ BitNet ที่เพิ่งเปิดตัวใหม่ แก้ไขข้อจำกัดเหล่านี้โดยรองรับการปรับแต่ง LoRA แบบ cross-platform และเร่งการประมวลผลข้อสรุปในช่วง consumer GPU ที่หลากหลาย ซึ่งรวมถึงฮาร์ดแวร์จาก Intel, AMD และ Apple Silicon เป็นต้น ผลลัพธ์คือผู้ใช้สามารถฝึกอบรมและปรับแต่งโมเดล AI ได้โดยตรงบนอุปกรณ์ผู้บริโภคที่หาได้ทั่วไปแทนที่จะต้องพึ่งพาโครงสร้างพื้นฐานแบบรวมศูนย์

บริษัทรายงานว่าทีมวิศวกรได้สาธิตการปรับแต่ง BitNet บนหน่วยประมวลผลกราฟิกมือถือสำเร็จเป็นครั้งแรก รวมถึงแพลตฟอร์มต่างๆ เช่น Adreno, Mali และ Apple Bionic GPU การทดสอบภายในระบุว่าโมเดล BitNet ที่มีพารามิเตอร์ 125 ล้านตัวสามารถปรับแต่งได้ในเวลาประมาณสิบนาทีบนอุปกรณ์ Samsung S25 ที่ติดตั้ง Adreno GPU โดยใช้ชุดข้อมูลทางชีวการแพทย์ที่ประกอบด้วยเอกสารประมาณ 300 ฉบับ หรือประมาณ 18,000 โทเค็น สำหรับโมเดลที่มีพารามิเตอร์ 1 พันล้านตัว ชุดข้อมูลเดียวกันต้องใช้เวลาประมาณหนึ่งชั่วโมงสิบแปดนาทีบน Samsung S25 และหนึ่งชั่วโมงสี่สิบห้านาทีบน iPhone 16 บริษัทยังรายงานว่าสามารถขยายการทดสอบไปยังโมเดลที่มีขนาดใหญ่ถึง 13 พันล้านพารามิเตอร์บน iPhone 16 ภายใต้เงื่อนไขความจุสูงสุดของอุปกรณ์

ความก้าวหน้าในการฝึกอบรม AI บน Edge และการเพิ่มประสิทธิภาพ

ผลการค้นพบเพิ่มเติมชี้ให้เห็นว่า framework สามารถรองรับการปรับแต่งโมเดลที่มีขนาดใหญ่ถึงสองเท่าของโมเดลที่ไม่ใช่ BitNet ที่เทียบเคียงกันซึ่งทำงานภายใต้ Q4 quantization บนอุปกรณ์ edge ผลลัพธ์นี้มาจากการใช้หน่วยความจำที่ลดลงซึ่งเกี่ยวข้องกับสถาปัตยกรรม BitNet

นอกจากการปรับปรุงในการฝึกอบรมแล้ว framework ยังแสดงประสิทธิภาพการประมวลผลข้อสรุปที่เพิ่มขึ้น การทดสอบที่ดำเนินการบนอุปกรณ์มือถือระบุว่าโมเดล BitNet ทำงานเร็วขึ้นอย่างมากเมื่อทำงานบน GPU โดยมีความเร็วในการประมวลผลตั้งแต่สองถึงสิบเอ็ดเท่าเมื่อเทียบกับการทำงานบน CPU ผลลัพธ์เหล่านี้บ่งชี้ว่า GPU มือถือมีความสามารถมากขึ้นในการจัดการปริมาณงานที่ก่อนหน้านี้ต้องใช้ฮาร์ดแวร์เฉพาะทางหรือทรัพยากรระดับศูนย์ข้อมูล

ระบบยังแสดงการเพิ่มขึ้นที่น่าสังเกตในประสิทธิภาพหน่วยความจำ ข้อมูลมาตรฐานชี้ให้เห็นว่าโมเดล BitNet-1B ที่ใช้การกำหนดค่า TQ1_0 ต้องการ VRAM น้อยกว่าถึง 77.8 เปอร์เซ็นต์เมื่อเทียบกับโมเดล Gemma-3-1B แบบ 16-bit และน้อยกว่า 65.6 เปอร์เซ็นต์เมื่อเทียบกับโมเดล Qwen3-0.6B แบบ 16-bit ในระหว่างกระบวนการประมวลผลข้อสรุปและการปรับแต่ง LoRA การลดลงเหล่านี้ให้ความจุเพิ่มเติมสำหรับการรันโมเดลที่ใหญ่ขึ้นและเปิดใช้งานคุณสมบัติการปรับแต่งส่วนบุคคลบนฮาร์ดแวร์ที่ก่อนหน้านี้ถือว่าไม่เพียงพอ

Tether ระบุเพิ่มเติมว่า framework แนะนำความสามารถในการปรับแต่ง LoRA สำหรับโมเดลภาษาขนาดใหญ่แบบ 1-bit บนฮาร์ดแวร์ที่ไม่ใช่ NVIDIA เป็นครั้งแรก โดยขยายความเข้ากันได้ไปยัง AMD, Intel, Apple Silicon และแพลตฟอร์ม mobile GPU โดยการลดการพึ่งพาโครงสร้างพื้นฐานเฉพาะทางและบริการคลาวด์ แนวทางนี้ช่วยให้ข้อมูลที่ละเอียดอ่อนสามารถเก็บไว้ในเครื่องบนอุปกรณ์ของผู้ใช้ บริษัทระบุว่าประสิทธิภาพนี้อาจสนับสนุนการพัฒนาระบบ federated learning ซึ่งโมเดลสามารถฝึกอบรมร่วมกันในอุปกรณ์ที่กระจายอยู่ในขณะที่รักษาความเป็นส่วนตัวของข้อมูลและลดการพึ่งพาระบบแบบรวมศูนย์

โพสต์ Tether เปิดตัว Cross-Platform BitNet LoRA Framework ที่ช่วยให้สามารถฝึกอบรมและประมวลผล AI พารามิเตอร์หลายพันล้านบนอุปกรณ์ผู้บริโภคได้ ปรากฏครั้งแรกบน Metaverse Post

คุณอาจชอบเช่นกัน

การลงคะแนนเสียงในวุฒิสภาสำหรับ Clarity Act กำหนดในวันพฤหัสบดี ขณะที่การต่อสู้เรื่องผลตอบแทน Stablecoin ถึงจุดเดือด

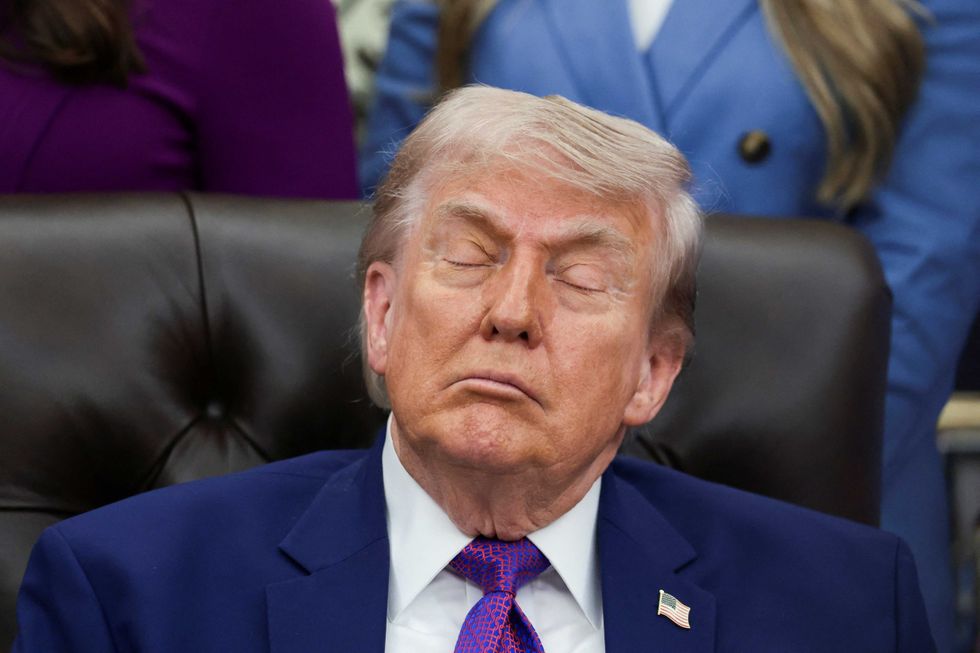

ผู้เชี่ยวชาญทางการแพทย์ออกคำเตือนอย่างหนักเกี่ยวกับทรัมป์ท่ามกลาง 'การเสื่อมถอยอย่างรวดเร็ว': นักวิเคราะห์