แพลตฟอร์ม AI-Native สำหรับองค์กร: Responsive ปรับสถาปัตยกรรม SaaS ใหม่เพื่อ Governed Intelligence อย่างไร

แพลตฟอร์มองค์กรที่ใช้ AI เป็นพื้นฐาน: เราจะก้าวข้าม AI Copilots ได้ในที่สุดหรือไม่?

เคยเห็นแชทบอท AI ที่มีแนวโน้มดีทำลายการตอบกลับ RFP ที่สำคัญหรือไม่?

ทีมขายแข่งกับเวลา

AI ร่างคำตอบ

แต่การปฏิบัติตามข้อกำหนดพบความไม่ถูกต้อง

การตรวจสอบความปลอดภัยหยุดชะงัก

ฝ่ายกฎหมายตรวจสอบทุกอย่างใหม่

"copilot" ประหยัดเวลาไม่กี่นาที

องค์กรสูญเสียเวลาหลายสัปดาห์

นี่คือปัญหาที่แท้จริงของ AI ใน enterprise SaaS หรือไม่?

เรากำลังเพิ่มการทำงานอัตโนมัติทับสถาปัตยกรรมเดิมหรือไม่?

หรือเรากำลังออกแบบระบบใหม่เพื่อคิด เรียนรู้ และควบคุมอย่างมีความรับผิดชอบ?

นั่นคือจุดเริ่มต้นของเนื้อหาพิเศษจาก CXQuest.com นี้

CXQuest.com นำเสนอ Sankar Lagudu, COO และ Co-founder ของ Responsive (เดิมชื่อ RFPIO) ผู้นำระดับโลกในซอフต์แวร์จัดการการตอบกลับเชิงกลยุทธ์ที่ให้บริการองค์กรในกว่า 175 ประเทศ ภายใต้การนำด้านปฏิบัติการของเขา Responsive ได้พัฒนาเป็นแพลตฟอร์มการจัดการการตอบกลับที่นำโดย AI ซึ่งมีลูกค้าใช้งานเกือบ 2,000 ราย รวมถึง 20% ของ Fortune 100

Sankar เชื่อมโยงความลึกทางวิศวกรรมกับการปฏิบัติงาน

เขาเข้าใจว่าระบบ AI ถูกสร้างขึ้นอย่างไร

เขาเข้าใจว่าระบบล้มเหลวอย่างไร

และที่สำคัญกว่านั้น เขาเข้าใจวิธีควบคุมระบบในระดับใหญ่

เมื่อการนำ AI agent มาใช้เร่งตัวขึ้น มีเพียงส่วนน้อยขององค์กรที่มีมาตรการป้องกันที่แข็งแกร่ง แล้วอะไรคือสิ่งที่แยกการทดลองออกจากความชาญฉลาดระดับองค์กร?

ในการสนทนา CX เชิงกลยุทธ์ขั้นสูงนี้ เราสำรวจกรอบงาน โมเดลการกำกับดูแล และผลลัพธ์ที่วัดได้ที่กำลังสร้างแพลตฟอร์มองค์กรที่ใช้ AI เป็นพื้นฐาน

AI กลายเป็นสถาปัตยกรรมจากการช่วยเหลือ

คำถาม 1. ชัยชนะด้าน CX หรือ EX ใดที่ทำให้คุณประหลาดใจมากที่สุดเมื่อ AI กลายเป็นแกนหลักของแพลตฟอร์มของคุณ—ไม่ใช่เพียงส่วนเสริม?

SL: เมื่อ AI กลายเป็นสถาปัตยกรรมมากกว่าการช่วยเหลือ สิ่งที่น่าประหลาดใจที่สุดคือการลดภาระทางปัญญา ทีมหยุดการค้นหาและรวบรวมข้อมูลด้วยตนเอง แต่พวกเขาเริ่มตรวจสอบผลลัพธ์อัจฉริยะแทน การเปลี่ยนแปลงนั้นเพิ่มความมั่นใจ ความเร็ว และความสม่ำเสมอ — ปรับปรุงทั้งประสบการณ์ลูกค้าและประสบการณ์พนักงานไปพร้อมกัน

คำถาม 2. คุณรู้ได้เมื่อใดว่า copilots ไม่เพียงพอและสถาปัตยกรรมต้องเปลี่ยนแปลง?

SL: Copilots ช่วยเหลือบุคคล องค์กรต้องการการประสานงาน เราตระหนักว่าการช่วยเหลือเพียงอย่างเดียวยังคงทิ้งการประสานงานด้วยตนเองมากเกินไประหว่างระบบ เมื่อลูกค้าเริ่มคาดหวังการดำเนินการ — ไม่ใช่คำแนะนำ — มันชัดเจนว่า AI ต้องถูกฝังลงในเวิร์กโฟลว์ สิทธิ์ และเลเยอร์การกำกับดูแล

คำถาม 3. "AI-native" หมายความว่าอย่างไรอย่างแท้จริงนอกเหนือจากภาษาการตลาด?

SL: AI-native หมายความว่า AI เป็นรากฐานของวิธีการทำงานของแพลตฟอร์ม มันแจ้งโมเดลข้อมูล เวิร์กโฟลว์ การควบคุมการเข้าถึง และลูปข้อเสนอแนะ หาก AI สามารถถูกลบออกโดยไม่เปลี่ยนแปลงพฤติกรรมของระบบ มันไม่ใช่ AI-native

มูลค่าในระบบ AI-native

คำถาม 4. ทีมแนวหน้าได้รับประสบการณ์มูลค่าที่แตกต่างกันอย่างไรในระบบ AI-native?

SL: ทีมแนวหน้าเปลี่ยนจากการปฏิบัติงานด้วยตนเองเป็นการกำกับดูแลที่ขับเคลื่อนด้วยการตัดสินใจ แทนที่จะรวบรวมการตอบกลับ พวกเขาปรับแต่งและอนุมัติผลลัพธ์อัจฉริยะ ลักษณะของงานเคลื่อนจากความพยายามซ้ำๆ ไปสู่การคิดเชิงกลยุทธ์ — เพิ่มทั้งผลผลิตและความมั่นใจ

คำถาม 5. คุณออกแบบแพลตฟอร์มองค์กร AI-native ที่ทำงานเป็นระบบข่าวกรองที่มีการกำกับดูแลอย่างไร?

SL: เราออกแบบโดยให้การกำกับดูแลเป็นอันดับแรก AI ต้องทำงานภายในการควบคุมการเข้าถึงตามบทบาท แหล่งความรู้ที่มีโครงสร้าง เส้นทางการตรวจสอบ และเกณฑ์ความมั่นใจที่กำหนด ความชาญฉลาดโดยไม่มีการกำกับดูแลไม่สามารถขยายอย่างปลอดภัยได้

คำถาม 6. เลเยอร์การกำกับดูแลใดที่ต้องมีก่อนขยาย AI agents ทั่วองค์กรระดับโลก?

SL: สามเลเยอร์มีความสำคัญ:

A• การกำกับดูแลข้อมูลสำหรับความสมบูรณ์ของแหล่งที่มาและสายเลือด

B• การกำกับดูแลการดำเนินงานสำหรับความชัดเจนของบทบาทและความรับผิดชอบ

C• การกำกับดูแล AI สำหรับการตรวจสอบ การกำกับดูแล และกลไกสำรอง

หากไม่มีเลเยอร์เหล่านี้ การขยายจะเพิ่มความเสี่ยง

คำถาม 7. คุณฝังความสามารถในการตรวจสอบโดยไม่ชะลอการดำเนินการอย่างไร?

SL: ความสามารถในการตรวจสอบต้องถูกสร้างขึ้นในเวิร์กโฟลว์เอง ทุกการกระทำ คำแนะนำ และการอนุมัติควรสามารถติดตามได้โดยอัตโนมัติ เมื่อการปฏิบัติตามข้อกำหนดถูกฝังไว้แทนที่จะเพิ่มเข้ามาภายหลัง ความเร็วในการดำเนินการและความไว้วางใจจะดีขึ้นทั้งสอง

สร้างสมดุลระหว่างการเรียนรู้อย่างต่อเนื่องกับความมั่นคงในการปฏิบัติตามข้อกำหนด

คำถาม 8. คุณสร้างสมดุลการเรียนรู้อย่างต่อเนื่องกับความมั่นคงในการปฏิบัติตามข้อกำหนดในอุตสาหกรรมที่มีการควบคุมอย่างไร?

SL: การเรียนรู้อย่างต่อเนื่องต้องทำงานภายในแนวกั้น การปรับปรุงโมเดลควรเพิ่มประสิทธิภาพแต่ไม่เคยเอาชนะนโยบายหรือข้อจำกัดการปฏิบัติตามข้อกำหนด ในสภาพแวดล้อมที่มีการควบคุม วิวัฒนาการต้องถูกวัดและควบคุม

คำถาม 9. สถาปัตยกรรม AI-native ปรับปรุงความแม่นยำในการตอบกลับใน RFPs, DDQs และแบบสอบถามความปลอดภัยอย่างไร?

SL: ความแม่นยำดีขึ้นเมื่อระบบเข้าใจความรู้ที่มีโครงสร้าง การตอบกลับในอดีต ความเกี่ยวข้องตามบริบท และกฎการกำกับดูแลพร้อมกัน สถาปัตยกรรม AI-native สังเคราะห์ข้อมูลที่ตรวจสอบแล้วแบบเรียลไทม์ในขณะที่รักษาความสามารถในการติดตาม

คำถาม 10. กรอบงานใดที่จัดแนวผลิตภัณฑ์ การดำเนินงาน และการกำกับดูแล AI เข้าสู่โมเดลรับผิดชอบเดียว?

SL: การจัดแนวต้องการเมตริกผลลัพธ์ที่แบ่งปัน ผลิตภัณฑ์กำหนดความสามารถ การดำเนินงานกำหนดเวิร์กโฟลว์ และการกำกับดูแล AI กำหนดแนวกั้น ทั้งสามต้องทำงานภายใต้ความรับผิดชอบแบบรวมแทนที่จะเป็นการเป็นเจ้าของคุณสมบัติที่แยกกัน

คำถาม 11. คุณกระทบยอดความขัดแย้งระหว่าง CX-cost ในเวิร์กโฟลว์องค์กรที่ประสาน AI อย่างไร?

SL: เมื่อ AI ลดความขัดแย้งและการทำงานซ้ำ ประสบการณ์ลูกค้าดีขึ้นในขณะที่ต้นทุนการดำเนินงานลดลง ความขัดแย้งเกิดขึ้นเฉพาะเมื่อ AI ถูกวางทับแทนที่จะฝังลงในเวิร์กโฟลว์หลัก

AI ขยาย ROI โดยไม่เพิ่มความเสี่ยง

คำถาม 12. เมตริกใดที่พิสูจน์ว่า agentic AI ขยาย ROI โดยไม่เพิ่มความเสี่ยง?

SL: เราประเมิน ROI พร้อมกับตัวบ่งชี้ความเสี่ยง เมตริกสำคัญรวมถึงการลดเวลาวงจร อัตราความแม่นยำ การลดการทำงานซ้ำ การปรับปรุงอัตราการชนะ และอัตราข้อยกเว้นการตรวจสอบ ประสิทธิภาพและความเสี่ยงต้องถูกวัดด้วยกัน

คำถาม 13. การบรรจบกันของการวิเคราะห์ ระบบความรู้ และการทำงานอัตโนมัติกำหนดการตัดสินใจขององค์กรใหม่อย่างไร?

SL: เมื่อการวิเคราะห์ ระบบความรู้ และการทำงานอัตโนมัติบรรจบกัน องค์กรเคลื่อนจากการตอบสนองแบบตอบโต้ไปสู่การประสานงานเชิงรุก การตัดสินใจกลายเป็นตามบริบท อิงหลักฐาน และเร็วขึ้นโดยไม่เสียสละความรับผิดชอบ

คำถาม 14. การเปลี่ยนแปลงทางวัฒนธรรมใดที่ผู้นำต้องยอมรับก่อนที่แพลตฟอร์ม AI-native จะประสบความสำเร็จอย่างแท้จริง?

SL: ผู้นำต้องเปลี่ยนจากการควบคุมโดยกระบวนการเป็นการควบคุมโดยหลักการ แทนที่จะจัดการผลลัพธ์ผ่านเลเยอร์ของการกำกับดูแลด้วยตนเอง ผู้นำกำหนดแนวกั้นและอนุญาตให้ระบบข่าวกรองที่มีการกำกับดูแลดำเนินการภายในนั้น ความไว้วางใจ ความชัดเจนของวัตถุประสงค์ และความรับผิดชอบยังคงเป็นสิ่งสำคัญ

คำถาม 15. ห้าปีข้างหน้าของ AI ที่มีการกำกับดูแลใน SaaS มีลักษณะอย่างไรสำหรับองค์กรที่ดำเนินงานทั่วโลก?

SL: แพลตฟอร์ม SaaS จะพัฒนาเป็นระบบข่าวกรองที่มีการกำกับดูแล เวิร์กโฟลว์ Agentic จะดำเนินการภายในแนวกั้นที่กำหนด ความสามารถในการตรวจสอบจะเป็นอย่างต่อเนื่อง การตัดสินใจของมนุษย์จะยังคงเป็นศูนย์กลาง ขยายด้วยระบบอัจฉริยะ องค์กรที่ถือว่า AI เป็นโครงสร้างพื้นฐาน ไม่ใช่การทดลอง จะเป็นผู้นำ

ทำไมการสนทนานี้สำคัญตอนนี้

AI ใน CX กำลังเข้าสู่ขั้นที่สอง

ขั้นที่หนึ่งเพิ่ม copilots

ขั้นที่สองออกแบบแพลตฟอร์มใหม่

ความแตกต่างคืออะไร?

การทำงานอัตโนมัติแบบเลเยอร์ปรับปรุงงาน

ระบบ AI-native เปลี่ยนแปลงการดำเนินการ

ข้อมูลเชิงลึกหลักจากการสนทนานี้:

การกำกับดูแลคือสถาปัตยกรรม ไม่ใช่นโยบาย

ความสามารถในการตรวจสอบต้องถูกฝังไว้ ไม่ใช่ติดตั้งย้อนหลัง

ความไว้วางใจขยายก่อนความชาญฉลาด

มูลค่า AI วัดโดยความแม่นยำ ความเร็วในการปฏิบัติตามข้อกำหนด และคุณภาพการดำเนินการ

วิวัฒนาการของ Responsive แสดงให้เห็นสิ่งที่เกิดขึ้นเมื่อ AI กลายเป็นรากฐานมากกว่าการตกแต่ง

สำหรับผู้นำ CX ที่นำทางการลงทุน AI การสนทนานี้เชื่อมต่อโดยตรงกับธีมที่กว้างขึ้นที่สำรวจใน AI in CX hub ของ CXQuest:

โมเดลการกำกับดูแล AI

Agentic AI และการวัด ROI

กรอบการทำงานอัตโนมัติที่มีความรับผิดชอบ

การขยายความชาญฉลาดทั่วองค์กรระดับโลก

หาก AI กำลังกลายเป็นโครงสร้างพื้นฐาน ไม่ใช่คุณสมบัติ คำถามที่แท้จริงคือ:

องค์กรพร้อมที่จะออกแบบใหม่รอบๆ ข่าวกรองที่มีการกำกับดูแลหรือไม่?

สำรวจการสนทนาเพิ่มเติมในซีรีส์ AI in CX ของเรา

ใคร่ครวญสถาปัตยกรรมก่อนเพิ่ม copilot อีกตัว

สร้างระบบที่เรียนรู้อย่างมีความรับผิดชอบ

ขยายความไว้วางใจก่อนขยายความเร็ว

โพสต์ AI-Native Enterprise Platforms: How Responsive Is Re-Architecting SaaS for Governed Intelligence ปรากฏครั้งแรกบน CX Quest

คุณอาจชอบเช่นกัน

หุ้น ServiceNow (NOW): Bank of America ตั้งเป้าราคา $130 หลังการขายหุ้นครั้งใหญ่

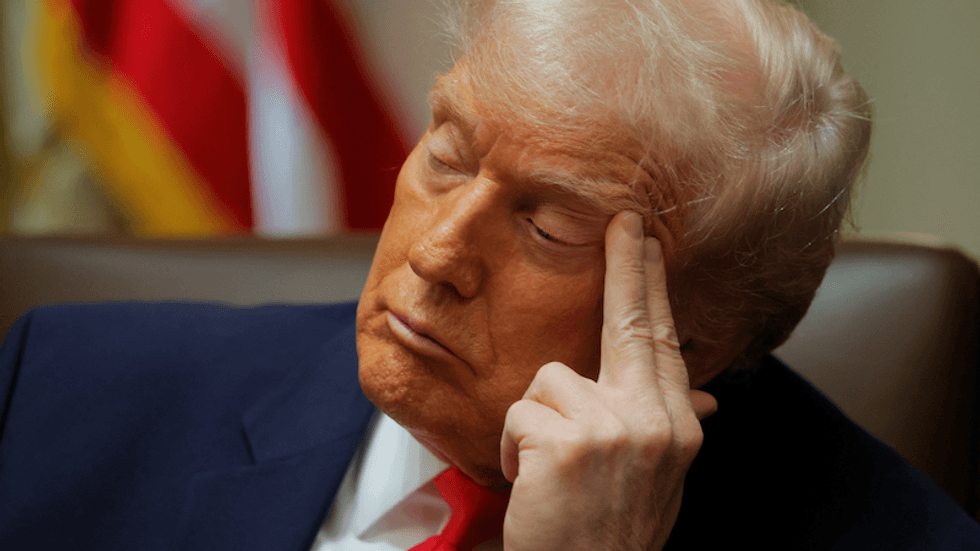

ความสามารถที่ 'ลดลง' ของทรัมป์ที่เชื่อมโยงกับวัยบน MS NOW: 'สงสัยว่านั่นคือสิ่งที่เราเห็นหรือเปล่า'