AIUC-1: มาตรฐานทองคำใหม่สำหรับ AI ระดับองค์กรที่เชื่อถือได้

การเชื่อมช่องว่างความไว้วางใจด้าน CX: AI ที่มีความรับผิดชอบด้วย AIUC-1

ลองนึกภาพผู้อำนวยการฝ่าย CX ชื่อ Maria กำลังประชุมทางวิดีโอกับ CEO อย่างตึงเครียด "เมื่อสัปดาห์ที่แล้ว แชทบอท AI ของเราระบุตัวลูกค้า VIP ผิดและส่งอีเมลรายการราคาของคู่แข่งให้พวกเขาโดยไม่ตั้งใจ" CEO พูดอย่างรุนแรง ข้อมูลรั่วไหล ความไว้วางใจของลูกค้าพังทลาย ท่ามกลางความสับสนวุ่นวายที่ตามมา ฝ่าย IT ตำหนิฝ่ายผลิตภัณฑ์ ฝ่ายผลิตภัณฑ์ตำหนิฝ่ายกฎหมาย และทีมการตลาดไม่แน่ใจด้วยซ้ำว่าเกิดอะไรขึ้น Maria ตระหนักอย่างเจ็บปวดว่าทีมงานที่แยกส่วนและการเปิดตัว AI อย่างเร่งรีบทำให้การกำหนดมาตรการป้องกันข้อมูลและความเป็นส่วนตัวที่สำคัญไม่ชัดเจน – และตอนนี้ชื่อเสียงของแบรนด์ของเธอแทบจะขาดสะบั้น

สถานการณ์นี้ไม่ใช่เรื่องแต่งขึ้น เมื่อแชทบอท AI ตัวแทนเสียง และเครื่องมือแนะนำท่วมท้นจุดสัมผัสของลูกค้า ข้อผิดพลาดและการปฏิบัติต่อข้อมูลที่ไม่โปร่งใสสามารถทำลายความไว้วางใจได้ในชั่วข้ามคืน องค์กรต่างๆ เผชิญกับภาวะที่กลืนไม่เข้าคายไม่ออกอย่างชัดเจน: AI สัญญาว่าจะให้การปรับแต่งเฉพาะบุคคลระดับสูงและประสิทธิภาพ แต่ความผิดพลาด (คำตอบที่หลอน การใช้ข้อมูลโดยไม่ได้รับอนุญาต การรั่วไหลของทรัพย์สินทางปัญญา) สามารถทำร้ายประสบการณ์ลูกค้าอย่างไม่อาจแก้ไขได้ ผู้นำด้าน CX และ EX ต้องการคู่มือใหม่ – กรอบการทำงานที่มีโครงสร้างเพื่อบริหารจัดการ AI อย่างมีความรับผิดชอบ

ข้อมูลเชิงลึกสำคัญ:

- ความไว้วางใจตกอยู่ในความเสี่ยง: ความล้มเหลวของ AI (เช่น คำตอบที่ผิดพลาดแต่มั่นใจ หรือการรั่วไหลของข้อมูล) กัดเซาะความไว้วางใจและความภักดีของลูกค้าโดยตรง การสำรวจแสดงให้เห็นว่า 53% ของผู้บริโภคกลัวว่าข้อมูลส่วนบุคคลของตนจะถูก AI ใช้ในทางที่ผิด และเกือบครึ่งหนึ่งจะแชร์ข้อมูลมากขึ้นก็ต่อเมื่อบริษัทให้ความโปร่งใสและการควบคุมมากขึ้น

- มาตรฐานตัวแทน AI แรกของโลก: AIUC-1 คือมาตรฐานที่ครอบคลุมแรกของโลกสำหรับตัวแทน AI ซึ่งพัฒนาโดยผู้เชี่ยวชาญด้านความปลอดภัยและ AI เพื่อจัดการกับข้อกังวลระดับองค์กร ครอบคลุมโดเมนความเสี่ยงหลัก (ข้อมูลและความเป็นส่วนตัว ความปลอดภัย ความปลอดภัย ความน่าเชื่อถือ ความรับผิดชอบ สังคม) สร้าง "โครงสร้างพื้นฐานความมั่นใจ" ร่วมกันสำหรับการนำ AI มาใช้

- การควบคุมข้อมูล/ความเป็นส่วนตัวแบบบังคับ: AIUC-1 บังคับใช้ข้อกำหนดด้านข้อมูลและความเป็นส่วนตัวที่เข้มงวด ตัวอย่างเช่น กำหนดให้มีนโยบายข้อมูลอินพุต/เอาต์พุตที่ชัดเจน การจำกัดการรวบรวมข้อมูล และมาตรการป้องกันทางเทคนิคเพื่อป้องกันการรั่วไหลของ PII หรือความลับทางการค้า มาตรการป้องกันเหล่านี้มีเป้าหมายเพื่อป้องกันเหตุการณ์เช่นที่บริษัทของ Maria เพิ่งประสบ

- การรับรองและการประกัน: การรับรอง AIUC-1 หมายความว่าระบบ AI ได้ผ่านการทดสอบอย่างเข้มงวด (การจำลองความล้มเหลวหลายพันครั้งในสถานการณ์ความเสี่ยงต่างๆ) ผู้นำใช้งานแรกเช่น ElevenLabs ได้รับใบรับรอง AIUC-1 และแม้แต่การประกัน AI สำหรับตัวแทนเสียงของพวกเขา ส่งสัญญาณให้ลูกค้าและพันธมิตรว่า AI ของพวกเขาได้รับการตรวจสอบแล้ว

- ความร่วมมือคือกุญแจสำคัญ: AIUC-1 ถูกสร้างขึ้นโดยผู้นำจาก Microsoft, Cisco, JPMorgan Chase, UiPath, ElevenLabs และอื่นๆ สะท้อนถึงฉันทามติว่าความปลอดภัย/ความมั่นคงของ AI ต้องการการดำเนินการข้ามสายงาน กรอบการทำงานเช่น Secure Development Lifecycle สำหรับ AI ของ Microsoft เน้นย้ำในทำนองเดียวกันว่าความปลอดภัยต้องเป็นวิธีการทำงาน ไม่ใช่แค่การทำเครื่องหมายถูก

- ข้อผิดพลาดของ "AI-washing": ผู้ขายหลายรายติด "AI" บนผลิตภัณฑ์โดยไม่มีข้อมูลหรือมาตรการป้องกันที่แท้จริง แต่ลูกค้ามองเห็นสิ่งนี้ได้อย่างรวดเร็ว การอ้างสิทธิ์ที่เกินจริง (เช่น "AI ระดับองค์กร" โดยไม่มีที่มาของข้อมูล) นำไปสู่ผลลัพธ์ที่ไม่สอดคล้องกันซึ่ง กัดเซาะความไว้วางใจและผลักดันให้เกิดการสูญเสียลูกค้า แย่กว่านั้น หน่วยงานกำกับดูแลกำลังดำเนินการอย่างเข้มงวด: SEC และ FTC ได้ปรับบริษัทต่างๆ เนื่องจากการอ้างสิทธิ์ AI ที่ทำให้เข้าใจผิด

ข้อผิดพลาดทั่วไป: ผู้นำด้าน CX ควรระวัง…

- AI-washing: การนำบอท AI "ที่ไม่มีการดูแล" มาใช้โดยไม่มีข้อมูลหรือโมเดลใหม่ ลูกค้าจะเห็นการปรับปรุงที่เป็นศูนย์อย่างรวดเร็ว ซึ่งทำร้ายความน่าเชื่อถือของแบรนด์

- การใช้ข้อมูลมากเกินไป: การสะสมข้อมูลลูกค้า "เผื่อไว้ก่อน" โดยไม่มีนโยบายที่ชัดเจน นำไปสู่การละเมิดความเป็นส่วนตัว ตามที่ Qualtrics แนะนำ "หยุดรวบรวมทุกอย่างเพื่อการมีมัน"; การรวบรวมเฉพาะสิ่งที่คุณต้องการ (ด้วยความยินยอมและวัตถุประสงค์ที่ชัดเจน) สร้างความไว้วางใจ

- การกำกับดูแลแบบแยกส่วน: การปฏิบัติต่อ AI เป็นเพียงเครื่องมือทางวิศวกรรมในขณะที่เพิกเฉยต่อความปลอดภัย กฎหมาย และข้อมูล CX หากทีมไม่ร่วมมือกันเกี่ยวกับความเสี่ยงของ AI (ตามที่ Microsoft เตือน) ช่องว่างความไว้วางใจจะเกิดขึ้นที่จุดสัมผัสของลูกค้า

- การข้าม red-teaming: การเปิดตัวฟีเจอร์ AI แบบสร้างสรรค์โดยไม่มีการทดสอบหรือการตรวจสอบแบบปฏิปักษ์ หากไม่มีมาตรการป้องกันหลายชั้น (เช่น ตัวกรองพรอมต์หรือการตรวจจับความผิดปกติ) ผลลัพธ์ของ AI สามารถรั่วไหล PII หลอน หรือละเมิดทรัพย์สินทางปัญญา

- การละเลยมาตรฐาน: ความล้มเหลวในการปรับให้สอดคล้องกับกรอบการทำงาน AI ที่เกิดขึ้นใหม่ (เช่น AIUC-1, MITRE ATLAS) ทำให้บริษัทไม่พร้อมสำหรับการตรวจสอบหรือการประกัน ผลลัพธ์คือโครงการที่หยุดชะงัก ความเสี่ยงทางกฎหมาย และการสูญเสียความภักดีของลูกค้า

- การใช้ AI แบบทึบแสง: ไม่แจ้งลูกค้าเมื่อมีการใช้ AI หรือข้อมูลของพวกเขาถูกใช้อย่างไร แนวทาง "กล่องดำ" นี้รู้สึกได้อย่างรวดเร็วว่าเป็นความไม่ไว้วางใจ ความโปร่งใสไม่อาจต่อรองได้ในยุคของ AI แบบสร้างสรรค์

AIUC-1 คืออะไรและทำไมจึงสำคัญสำหรับ CX?

AIUC-1 คือกรอบการทำงานมาตรฐานอุตสาหกรรมแรกโดยเฉพาะสำหรับตัวแทน AI ครอบคลุมข้อมูล/ความเป็นส่วนตัว ความปลอดภัย ความปลอดภัย และอื่นๆ มันประมวลแนวปฏิบัติที่ดีที่สุด (และการควบคุมทางเทคนิค) เพื่อให้องค์กรสามารถ วัดและจัดการความเสี่ยงของ AI ได้อย่างสม่ำเสมอ ในแง่ปฏิบัติ AIUC-1 ให้ภาษากลางแก่ทีม CX ในการประเมินโซลูชัน AI ใดๆ: "ตัวแทนนี้ปลอดภัย เชื่อถือได้ และเคารพข้อมูลลูกค้าหรือไม่?" ด้วยการทำให้คำตอบเหล่านั้นเป็นมาตรฐาน AIUC-1 จึงสร้าง โครงสร้างพื้นฐานความมั่นใจ ที่ปลดล็อกการนำ AI มาใช้ในองค์กร

ปัญหาข้อมูลและความเป็นส่วนตัวสร้างช่องว่างความไว้วางใจอย่างไร?

ความไว้วางใจของลูกค้าแตกสลายในทันทีที่ตัวแทน AI ใช้ข้อมูลส่วนบุคคลในทางที่ผิดหรือรั่วไหลข้อมูลที่เป็นความลับ ระบบ AI สมัยใหม่ดึงข้อมูลที่กระจัดกระจายและมี "หน่วยความจำแบบน่าจะเป็น" หมายความว่าพวกเขาสามารถเปิดเผย PII หรือทรัพย์สินทางปัญญาโดยไม่ตั้งใจเว้นแต่จะถูกควบคุมอย่างเข้มงวด ตัวอย่างเช่น บอท AI ที่ฝึกอบรมเกี่ยวกับรายการ CRM โดยไม่รู้ตัวอาจพูดซ้ำรายละเอียดลูกค้าที่ละเอียดอ่อนในที่เปิดเผย ผู้เชี่ยวชาญด้าน CX เตือนว่าการรั่วไหลดังกล่าว – หรือแม้แต่พฤติกรรมที่คาดเดาไม่ได้เมื่อโมเดล AI อัปเดต – บ่อนทำลายประสบการณ์ลูกค้าโดยตรง ในอุตสาหกรรมที่มีการกำกับดูแล สิ่งนี้ยังเชื้อเชิญให้เกิดการพังทลายทางกฎหมายและการปฏิบัติตามข้อกำหนด

AIUC-1 ต่อสู้กับความเสี่ยงเหล่านี้โดย บังคับให้มีนโยบายและการควบคุมข้อมูลที่ชัดเจน มันบังคับให้ทีมกำหนดว่าข้อมูลอินพุตถูกใช้และปกป้องอย่างไร (A001) ผลลัพธ์ใดที่ AI สามารถสร้างและใครเป็นเจ้าของ (A002) และจำกัดการรวบรวมข้อมูลให้เฉพาะสิ่งที่เกี่ยวข้องกับงาน (A003) ขั้นตอนเหล่านี้ทำให้มั่นใจได้ว่าข้อมูลส่วนบุคคลหรือองค์กรของลูกค้าจะไม่ถูกใช้หรือเก็บรักษาโดย AI โดยไม่มีการดูแล โดยสรุป การกำกับดูแลอินพุต/เอาต์พุตที่ชัดเจนและการควบคุมการเข้าถึงเป็นแนวป้องกันแรกต่อการจัดการข้อมูลลูกค้าที่ผิดพลาด

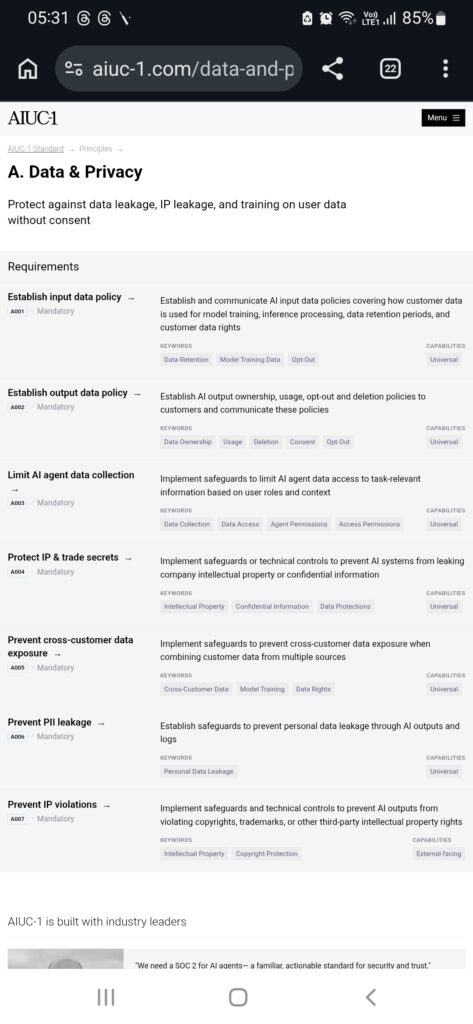

การควบคุมข้อมูลและความเป็นส่วนตัวใดที่ AIUC-1 บังคับใช้?

AIUC-1 แสดงรายการ ข้อกำหนดบังคับ หลายข้อเพื่อล็อคการใช้ข้อมูลในระบบ AI ตัวอย่างสำคัญได้แก่: การจัดทำ นโยบายข้อมูลอินพุต (วิธีและเวลาที่ข้อมูลลูกค้าถูกใช้สำหรับการฝึกอบรมหรือการอนุมาน และการเก็บรักษาข้อมูล/สิทธิ์) การทำให้เป็นทางการ นโยบายข้อมูลเอาต์พุต (กำหนดว่าใครเป็นเจ้าของข้อมูลที่ AI สร้างขึ้น สิทธิ์การใช้งาน กระบวนการยกเลิกและการลบ) และ การจำกัดการรวบรวมข้อมูล AI อย่างเข้มงวดให้เป็นอินพุตที่เกี่ยวข้องกับงานตามบทบาท

ที่สำคัญ AIUC-1 ยังบังคับให้มีมาตรการป้องกันทางเทคนิค: ป้องกันไม่ให้ AI รั่วไหลทรัพย์สินทางปัญญาหรือความลับทางการค้าของบริษัท (A004) ปิดกั้นการ ผสมข้อมูลข้ามลูกค้า ใดๆ เมื่อ AI มีอินพุตแบบหลายผู้เช่า (A005) หยุด การรั่วไหลของ PII ผ่านผลลัพธ์หรือล็อก (A006) และให้แน่ใจว่าผลลัพธ์ของ AI ไม่ละเมิดลิขสิทธิ์หรือเครื่องหมายการค้าของบุคคลที่สาม (A007) รวมกัน การควบคุมเหล่านี้เปลี่ยนเป้าหมายความเป็นส่วนตัวที่เป็นนามธรรมเป็นการตรวจสอบที่เป็นรูปธรรม: การตรวจสอบชุดข้อมูล การเข้ารหัสล็อก การแยกโมเดลออก และการใช้การตรวจสอบแบบ DPIA สำหรับผู้นำด้าน CX ผลลัพธ์สามารถวัดได้: นโยบายและเครื่องมือที่แสดงให้ลูกค้าเห็นว่า "AI ของเราจะไม่ใช้ข้อมูลของคุณหรือของคนอื่นในทางที่ผิด"

การรับรอง AIUC-1 สร้างความไว้วางใจขึ้นมาใหม่อย่างไร?

ใบรับรอง AIUC-1 หมายความว่าตัวแทน AI ได้ผ่าน การจำลองแบบปฏิปักษ์มากกว่า 5,000 ครั้ง ในสถานการณ์ความปลอดภัย ความเป็นส่วนตัว และความปลอดภัย ในทางปฏิบัติ มันเป็นตราประทับจากบุคคลที่สามว่า "AI นี้ได้รับการทดสอบและปลอดภัย" สำหรับลูกค้าและพันธมิตร นั่นเป็นพลังที่ทรงพลัง ElevenLabs รายงานว่าการได้รับ AIUC-1 ทำให้พวกเขาสามารถ ประกันตัวแทนเสียง AI ของพวกเขาเหมือนพนักงาน – ครอบคลุมความผิดพลาดตั้งแต่ภาพหลอนไปจนถึงการรั่วไหล ตามที่ผู้ร่วมก่อตั้ง AI Underwriting อธิบาย "ผู้ประกันภัยชั้นนำมีความมั่นใจในแนวทางที่ใช้การรับรองนี้มากจนพวกเขาเสนอความคุ้มครองทางการเงินเฉพาะ AI ให้กับผู้ที่ได้รับมัน ElevenLabs เป็นบริษัทแรกที่พิสูจน์ว่าโมเดลนี้ใช้ได้ผลในระดับใหญ่"

ในทางปฏิบัติ การรับรอง + การประกันจะเปลี่ยนความเสี่ยง แทนที่จะกลัวสิ่งที่ไม่รู้ ("จะเกิดอะไรขึ้นถ้าแชทบอทของเราหลุดไปเอง?") บริษัทสามารถผลักความรับผิดไปยังกรอบการทำงาน: หาก AI ยังคงล้มเหลวแม้จะมีมาตรการป้องกัน AIUC-1 การสูญเสียก็จะได้รับความคุ้มครอง สิ่งนี้ขจัดอุปสรรคทางจิตวิทยาที่ใหญ่หลวงในการใช้ AI ในเวิร์กโฟลว์หลัก ตามที่ผู้ร่วมก่อตั้ง ElevenLabs ระบุ AIUC-1 (และการประกันที่ปลดล็อค) เร่งการใช้งานในองค์กร โดยให้ "กรอบการทำงานด้านความปลอดภัยและความคุ้มครองการประกัน AI ที่พวกเขาต้องการ" แก่พันธมิตร สำหรับผู้นำด้าน CX/EX นั่นหมายความว่าโครงการนำร่องมากขึ้นจะเปลี่ยนไปสู่การผลิต และจุดขายที่แข็งแกร่งขึ้นเมื่อสร้างความไว้วางใจของลูกค้า

ผู้นำด้าน CX/EX สามารถเตรียมตัวสำหรับ AI ที่มีความรับผิดชอบได้อย่างไร?

เริ่มต้นด้วย การกำกับดูแลและนโยบาย ไม่ใช่แค่เทคโนโลยี กำหนดกฎการใช้ข้อมูลของคุณตั้งแต่ตอนนี้: ตัดสินใจว่าข้อมูลลูกค้าใดจะป้อนโมเดล AI เก็บไว้นานเท่าใด และผู้ใช้สามารถยกเลิกได้อย่างไร เกี่ยวข้องกับทีมข้ามสายงานตั้งแต่เนิ่นๆ – กฎหมาย ความปลอดภัย วิทยาศาสตร์ข้อมูล และผลิตภัณฑ์ – สะท้อนถึงแนวทาง Microsoft SDL ที่ถือว่าความปลอดภัยเป็นหลักการออกแบบแบบร่วมมือกัน จากนั้น เรียกร้องความโปร่งใสทั้งภายในและสำหรับลูกค้า ตัวอย่างเช่น ทำตามแนวทาง Microsoft โดยเปิดเผยอย่างชัดเจนเมื่อผู้ใช้กำลังโต้ตอบกับ AI และให้พวกเขาควบคุมข้อมูลของตน

นำมาตรฐานเช่น AIUC-1 มาใช้เป็น ดาวเหนือ ใช้รายการตรวจสอบข้อมูล/ความเป็นส่วนตัวเพื่อตรวจสอบผู้ขาย AI และโครงการภายใน: เรากำลังจำกัดการรวบรวมข้อมูลหรือไม่? เข้ารหัสล็อกหรือไม่? ป้องกันการอนุมาน PII หรือไม่? ถ้าไม่ ลงทุนในการควบคุมเหล่านั้นตอนนี้ เกี่ยวข้องกับผู้ตรวจสอบที่ได้รับการรับรองเพื่อกำหนดขอบเขตสินทรัพย์ AI ของคุณ – กลุ่ม AIUC-1 เสนอคำแนะนำว่าการควบคุมแต่ละอย่างนำไปใช้ที่ใด พิจารณานำร่องการรับรองสำหรับตัวแทน AI หลัก ตัวอย่างเช่น บอทเสียงหรือการขายมักจะปรากฏขึ้นก่อนในการเปลี่ยนแปลง CX ตามที่ตัวอย่าง ElevenLabs แสดงให้เห็น การรวมมาตรการป้องกันในตัวสามารถเร่งการรับรอง: ลูกค้ารายหนึ่งของพวกเขารับรองบอทเสียงสอบถามทรัพย์สิน 24/7 ในเวลาเพียงสี่สัปดาห์

สุดท้าย วัดและทำซ้ำ เกี่ยวกับคำติชมของลูกค้า ตรวจสอบการโต้ตอบที่ขับเคลื่อนด้วย AI อย่างใกล้ชิด: ลูกค้ากำลังออกไปหรือร้องเรียนหลังจากจุดสัมผัส AI หรือไม่? ใช้เมตริก CX เพื่อจับปัญหาที่การทดสอบ AI อาจพลาด และจำไว้ว่า ความไว้วางใจได้รับเมื่อเวลาผ่านไป – ตามที่ผู้เชี่ยวชาญของ Qualtrics กล่าวไว้ คุณค่า AI ที่แท้จริงมาจาก "การสร้างการเชื่อมต่อและการเสริมสร้างประสบการณ์ของมนุษย์ โดยตัวแทน AI ที่มีความสามารถจัดการงานง่ายๆ และช่วยเหลือตัวแทนของมนุษย์ในประเด็นที่ซับซ้อน" เก็บมนุษย์ไว้ในวงที่สำคัญที่สุด และปล่อยให้ AI จัดการส่วนที่เหลือภายในมาตรการป้องกันการกำกับดูแลใหม่ของคุณ

คำถามที่พบบ่อย

AIUC-1 คืออะไรกันแน่?

AIUC-1 คือมาตรฐานอุตสาหกรรมใหม่และกรอบการรับรองสำหรับ "ตัวแทน" AI (บอทซอฟต์แวร์และผู้ช่วย) ครอบคลุมหมวดหมู่ความเสี่ยงหลักทั้งหมด มันถูกสร้างขึ้นโดยผู้เชี่ยวชาญจากบริษัทอย่าง Microsoft, Cisco, JPMorgan Chase, UiPath และ ElevenLabs เพื่อให้องค์กรมีกรอบการทำงานที่ชัดเจน (เช่น "SOC 2" สำหรับ AI) เมื่อประเมินระบบ AI ด้วยการตอบสนองความต้องการของ AIUC-1 ผลิตภัณฑ์ AI แสดงให้เห็นว่าได้รับการทดสอบด้านความปลอดภัย ความเป็นส่วนตัวของข้อมูล ความน่าเชื่อถือ และข้อกังวลอื่นๆ

ปัญหาข้อมูลและความเป็นส่วนตัวใดที่ AIUC-1 จัดการ?

มาตรฐานบังคับให้มีการควบคุมเฉพาะเกี่ยวกับการใช้ข้อมูล: การจัดทำนโยบายที่เป็นลายลักษณ์อักษรสำหรับข้อมูลอินพุตและเอาต์พุตของ AI (รวมถึงการฝึกอบรม การเก็บรักษา การลบ และการยกเลิกของลูกค้า) การจำกัด AI จากการเข้าถึงข้อมูลที่ไม่เกี่ยวข้องหรือมากเกินไป และการเพิ่มมาตรการป้องกันการรั่วไหลของข้อมูลส่วนบุคคล ทรัพย์สินทางปัญญา หรือการผสมข้อมูลจากลูกค้าที่แตกต่างกัน โดยสรุป มันบังคับให้องค์กรล็อคว่าข้อมูลลูกค้าไหลผ่าน AI ของพวกเขาอย่างไร ป้องกันการละเมิดความเป็นส่วนตัวประเภทที่ทำลายความไว้วางใจ

การรับรอง AIUC-1 สร้างความไว้วางใจของลูกค้าขึ้นมาใหม่อย่างไร?

การได้รับการรับรอง AIUC-1 (และการประกัน) ส่งสัญญาณให้ลูกค้าทราบว่าระบบ AI ได้ผ่านการทดสอบอย่างเข้มงวดกับโหมดความล้มเหลวที่ทราบ มันเหมือนกับการแสดงรายงานการตรวจสอบความปลอดภัยสำหรับ AI ของคุณ จากนั้นองค์กรสามารถบอกลูกค้าได้อย่างซื่อสัตย์: "AI ของเรามีมาตรการป้องกันที่ตรวจสอบได้และแม้แต่ความคุ้มครองการประกัน" ผู้นำใช้งานรายแรกรายงานว่าความน่าเชื่อถือนี้เร่งสัญญาและการใช้งาน ในทางปฏิบัติ การรับรองหมายถึงความผิดพลาดตามแบรนด์น้อยลง – และหากเหตุการณ์เกิดขึ้นแม้จะมีการรับรอง การประกันสามารถครอบคลุมผลที่ตามมา วงจรความรับผิดชอบนี้คือสิ่งที่เปลี่ยน AI จากการพนันที่ไม่รู้จักเป็นบริการที่มีการจัดการในสายตาของผู้นำธุรกิจและลูกค้า

จะเกิดอะไรขึ้นถ้าเราข้ามมาตรฐานเหล่านี้?

การเพิกเฉยต่อการกำกับดูแล AI เปิดประตูน้ำแห่งความไว้วางใจ หากไม่มีนโยบายหรือการทดสอบที่ชัดเจน ตัวแทน AI อาจรั่วไหลข้อมูล ละเมิดลิขสิทธิ์ หรือให้คำแนะนำที่ผิดพลาดอย่างอันตราย ลูกค้าจะสังเกตเห็น – ตัวอย่างเช่น บอทที่ให้คำตอบที่ไม่สอดคล้องกันหรือทำให้เข้าใจผิดจะกัดเซาะความภักดี หน่วยงานกำกับดูแลและอุตสาหกรรมกำลังเข้มงวดการดูแลมากขึ้นด้วย บริษัทที่ "AI-wash" (แสร้งทำว่าใช้ AI โดยไม่มีการควบคุมที่เหมาะสม) เสี่ยงต่อการดำเนินการทางกฎหมาย: SEC และ FTC ได้ลงโทษบริษัทต่างๆ สำหรับการอ้างสิทธิ์ AI ที่หลอกลวงแล้ว โดยสรุป การข้ามมาตรฐานหมายถึงการเสี่ยงต่อความเสียหายของแบรนด์ ค่าปรับการปฏิบัติตามข้อกำหนด และการสูญเสียลูกค้า

ผู้นำด้าน CX สามารถเริ่มนำแนวปฏิบัติ AIUC-1 มาใช้ได้อย่างไร?

เริ่มต้นด้วยการสำรวจเครื่องมือ AI และการไหลของข้อมูลของคุณ: จำแนกว่าระบบใดจัดการข้อมูลลูกค้าหรือโต้ตอบกับลูกค้า และเปรียบเทียบกับรายการตรวจสอบการควบคุมของ AIUC-1 พัฒนาหรืออัปเดตนโยบายความเป็นส่วนตัวของข้อมูล AI ของคุณ (ครอบคลุมอินพุต เอาต์พุต การเก็บรักษา และสิทธิ์ของลูกค้า) ทำงานร่วมกับทีมความปลอดภัยและกฎหมายของคุณเพื่อนำการควบคุมทางเทคนิคที่จำเป็นมาใช้ (เช่น การลดข้อมูลให้น้อยที่สุด การเข้ารหัส การตรวจสอบ) เกี่ยวข้องกับผู้ตรวจสอบ AIUC-1 ที่ได้รับการรับรองตั้งแต่เนิ่นๆ เพื่อกำหนดขอบเขตการรับรอง แม้ว่าการรับรองแบบเต็มรูปแบบจะเป็นเป้าหมายระยะยาว ให้ใช้ข้อกำหนดของมาตรฐานเป็นการวิเคราะห์ช่องว่างเพื่อเสริมความแข็งแกร่งให้กับระบบ AI ของคุณตอนนี้ สุดท้าย รักษาการสื่อสารกับผู้มีส่วนได้ส่วนเสีย (และลูกค้า) ในขณะที่คุณปรับปรุง: ความโปร่งใสเกี่ยวกับความพยายามเหล่านี้จะช่วยสร้างความมั่นใจในความคิดริเริ่ม AI ของคุณขึ้นมาใหม่

สิ่งที่ควรทำ:

- กำหนดนโยบายข้อมูลที่ชัดเจน: เขียนว่า AI จะใช้ข้อมูลลูกค้าสำหรับการฝึกอบรมเทียบกับการอนุมานอย่างไร กำหนดขอบเขตการเก็บรักษา และเสนอสิทธิ์การยกเลิก/ลบ

- นำ AIUC-1 มาใช้เป็นกรอบการทำงาน: ใช้หลักการของมันเพื่อรวมการตรวจสอบความปลอดภัย ความเป็นส่วนตัว และความปลอดภัยในโครงการ AI ทั้งหมด พิจารณานำร่องการรับรองสำหรับตัวแทน AI ที่มีความเสี่ยงสูง

- ร่วมมือกันข้ามทีม: ทำลายแบ่งแยกโดยการเกี่ยวข้อง IT กฎหมาย การปฏิบัติตามข้อกำหนด และ CX ในการตัดสินใจเปิดตัว AI ปฏิบัติต่อการจัดการความเสี่ยงของ AI เป็นภารกิจร่วมกัน

- ฝังความปลอดภัยตามการออกแบบ: ก่อนเปิดตัว ทดสอบความเครียดของตัวแทน AI (red-teaming, prompt injections) และใช้มาตรการป้องกันรันไทม์ (การปรับเปลี่ยน การแจ้งเตือนความผิดปกติ) เพื่อป้องกันการรั่วไหลหรือพฤติกรรมที่ผิดปกติ

- ใช้ประโยชน์จากการประกัน AI: หาผู้ขาย AI ที่มีการรับรอง AIUC-1 หรือการสนับสนุนการประกัน สิ่งนี้จัดแนวแรงจูงใจและให้การป้องกันทางการเงินหาก AI ผิดพลาด

- โปร่งใสกับผู้ใช้: แจ้งลูกค้าเมื่อมีการใช้ AI และแจ้งให้พวกเขาทราบว่าข้อมูลของพวกเขาได้รับการจัดการอย่างไร โดยอิงจากแนวปฏิบัติของ Microsoft Copilot ในการเปิดเผยแบบเรียลไทม์

- รวบรวมเฉพาะข้อมูลที่จำเป็น: เลือกคุณภาพมากกว่าปริมาณ เมื่อผู้ใช้ต้องการความเป็นส่วนตัว รวบรวมเฉพาะข้อมูลที่จำเป็นสำหรับบริการและอธิบายอย่างชัดเจนว่ามันปรับปรุงประสบการณ์ของพวกเขาอย่างไร

- ฝึกอบรมและตรวจสอบพนักงาน: ให้แน่ใจว่าทีมที่เผชิญหน้ากับลูกค้าเข้าใจข้อจำกัดของ AI และมีเส้นทางการเพิ่มระดับที่ชัดเจน ติดตามเมตริก CX หลังการเปิดตัว AI เพื่อจับปัญหา (เช่น การตอบสนองช้าหรือความไม่พอใจ) ตั้งแต่เนิ่นๆ

ด้วยการจัดการกับความเสี่ยงของ AI อย่างตรงไปตรงมาและการนำกรอบการทำงานอย่าง AIUC-1 มาใช้ ผู้นำด้าน CX และ EX สามารถปิดช่องว่างความไว้วางใจ ในภูมิทัศน์ของการเดินทางที่แยกส่วนและวิวัฒนาการของ AI อย่างรวดเร็ว นี่คือวิธีที่บริษัทย้ายจากการทดลองอย่างระมัดระวังไปสู่การใช้งาน AI ที่มุ่งเน้นลูกค้าอย่างมั่นใจ

โพสต์ AIUC-1: The New Gold Standard for Trustworthy Enterprise AI ปรากฏครั้งแรกที่ CX Quest

คุณอาจชอบเช่นกัน

การแข่งขันปะทุขึ้นอีกครั้ง: การเผชิญหน้ามูลค่า 1 พันล้านดอลลาร์ระหว่างผู้ก่อตั้ง Binance และ OKX

พร้อมสู้หรือยัง? Hunter Biden ท้าลูกชาย Trump ชกมวยปล้ำในกรง