CEO Anthropic odpowiada na zakaz wojskowego wykorzystania przez Pentagon

Debata polityczna wokół sztucznej inteligencji w kontekście obronności nasiliła się po tym, jak Departament Obrony USA uznał Anthropic za „zagrożenie dla łańcucha dostaw", skutecznie wykluczając jego modele AI z prac kontraktowych w dziedzinie obronności. Prezes Anthropic, Dario Amodei, odpowiedział w wywiadzie dla CBS News w sobotę, mówiąc, że firma nie będzie wspierać masowej krajowej inwigilacji ani w pełni autonomicznej broni. Argumentował, że takie możliwości podważają podstawowe prawa amerykańskie i przekazałyby podejmowanie decyzji o wojnie maszynom, co stanowi stanowisko precyzujące, gdzie firma zamierza, a gdzie nie zamierza działać w ramach szerszych przypadków użycia AI przez rząd.

Kluczowe wnioski

- Departament Obrony uznał Anthropic za „zagrożenie dla łańcucha dostaw", zakazując swoim wykonawcom używania modeli AI Anthropic w programach obronnych, co Amodei określił jako bezprecedensowy i karny ruch.

- Anthropic sprzeciwia się wykorzystywaniu swojej AI do masowej krajowej inwigilacji i autonomicznej broni, podkreślając, że nadzór ludzki pozostaje niezbędny dla decyzji wojennych.

- Amodei wyraził poparcie dla innych rządowych przypadków użycia technologii Anthropic, ale wyznaczył wyraźną granicę wokół ochrony prywatności i możliwości prowadzenia wojny podlegającej kontroli.

- Krótko po oznaczeniu Anthropic, rywalizujący OpenAI podobno zabezpieczył kontrakt z DoD na wdrożenie swoich modeli AI w sieciach wojskowych, sygnalizując rozbieżne trajektorie dostawców w przestrzeni obronna-AI.

- Wydarzenie wywołało reakcję online skupioną na prywatności, swobodach obywatelskich i zarządzaniu AI w bezpieczeństwie narodowym, podkreślając szerszą debatę na temat odpowiedzialnego wdrażania AI.

Wymienione tickery:

Nastroje: Neutralne

Kontekst rynkowy: Epizod znajduje się na przecięciu zarządzania AI, zamówień obronnych i apetytu na ryzyko wśród instytucjonalnych dostawców technologii w trakcie trwających debat politycznych.

Kontekst rynkowy: Polityka bezpieczeństwa narodowego, kwestie prywatności i niezawodność autonomicznych systemów AI nadal kształtują sposób, w jaki dostawcy technologii i wykonawcy obroni współdziałają z narzędziami AI w wrażliwych środowiskach, wpływając na szersze nastroje technologiczne i inwestycyjne w sąsiednich sektorach.

Dlaczego to ma znaczenie

Dla społeczności kryptowalutowej i szerszej branży technologicznej, epizod Anthropic podkreśla, jak polityka, zarządzanie i zaufanie kształtują przyjęcie zaawansowanych narzędzi AI. Jeśli agencje obronne zaostrzyją kontrole nad konkretnymi dostawcami, sprzedawcy mogą przekalibrować mapy drogowe produktów, modele ryzyka i ramy zgodności. Napięcie między rozszerzaniem możliwości AI a ochroną swobód obywatelskich wykracza poza kontrakty obronne, wpływając na sposób, w jaki inwestorzy instytucjonalni oceniają ekspozycję na platformy oparte na AI, usługi przetwarzania danych i obciążenia AI natywne dla chmury wykorzystywane przez sektory finansów, gier i aktywów cyfrowych.

Naleganie Amodeiego na zabezpieczenia odzwierciedla szersze zapotrzebowanie na odpowiedzialność i przejrzystość w rozwoju AI. Podczas gdy branża ściga się z wdrażaniem bardziej zaawansowanych modeli, rozmowa o tym, co stanowi akceptowalne użycie—szczególnie w inwigilacji i automatycznej wojnie—pozostaje nierozstrzygnięta. Ta dynamika nie ogranicza się do polityki amerykańskiej; rządy sojusznicze analizują podobne pytania, co może wpłynąć na współpracę transgraniczną, warunki licencjonowania i kontrole eksportowe. W ekosystemach kryptowalutowych i blockchain, gdzie zaufanie, prywatność i zarządzanie są już centralnymi kwestiami, każda zmiana polityki AI może przenikać przez analitykę on-chain, automatyczne narzędzia zgodności i zdecentralizowane aplikacje tożsamości.

Z perspektywy strukturyzacji rynku, zestawienie stanowiska Anthropic z wygraną kontraktową OpenAI—zgłoszoną krótko po ogłoszeniu DoD—ilustruje, jak różni dostawcy nawigują po tym samym terenie regulacyjnym. Publiczny dyskurs wokół tych wydarzeń może wpłynąć na sposób, w jaki inwestorzy wyceniają ryzyko związane z dostawcami technologii opartej na AI i dostawcami zapewniającymi krytyczną infrastrukturę dla sieci rządowych. Epizod podkreśla również rolę narracji medialnych w wzmacnianiu obaw dotyczących masowej inwigilacji i swobód obywatelskich, co z kolei może wpłynąć na nastroje interesariuszy i tempo regulacyjne wokół zarządzania AI.

Na co zwrócić uwagę

- Aktywna debata kongresowa nad zabezpieczeniami AI i ochroną prywatności, z potencjalnym ustawodawstwem wpływającym na krajową inwigilację, rozwój broni i kontrole eksportowe.

- Aktualizacje polityki DoD lub wytyczne dotyczące zamówień, które wyjaśniają, jak dostawcy AI są oceniani pod kątem ryzyka bezpieczeństwa narodowego i jak wdrażane są substytucje lub środki łagodzące ryzyko.

- Publiczne odpowiedzi od Anthropic i OpenAI, szczegółowo opisujące, jak każda firma planuje rozwiązać przypadki użycia rządowego, zgodność i ekspozycję na ryzyko.

- Ruchy innych wykonawców obronnych i dostawców AI w celu zabezpieczenia lub renegocjacji kontraktów DoD, w tym wszelkie zmiany w budowaniu sojuszy z dostawcami chmury i protokołami obsługi danych.

- Szersza reakcja inwestorów i rynku na rozwój zarządzania AI, szczególnie w sektorach zależnych od przetwarzania danych, usług chmurowych i obciążeń uczenia maszynowego.

Źródła i weryfikacja

- Wywiad CEO Anthropic, Dario Amodeiego, z CBS News omawiający jego stanowisko w sprawie masowej inwigilacji i autonomicznej broni: wywiad CBS News.

- Oficjalne oświadczenia dotyczące oznaczenia Anthropic jako „Zagrożenia dla Łańcucha Dostaw w Bezpieczeństwie Narodowym" przez kierownictwo DoD, poprzez publiczne kanały powiązane z dyskusjami politycznymi DoD i współczesnym zasięgiem: post Pete'a Hegsetha na X.

- Rozwój kontraktów obronnych OpenAI i publiczne dyskusje na temat wdrażania modeli AI w sieciach wojskowych, jak donosi Cointelegraph: zasięg kontraktu obronnego OpenAI.

- Krytyka skupiająca się na masowej inwigilacji wspieranej przez AI i obawach o swobody obywatelskie, do których odniesiono się w zasięgu szerszego dyskursu: Bruce Schneier o inwigilacji AI.

Konflikt polityczny dotyczący dostawców AI odbija się echem w technologii obronnej

Prezes Anthropic, Dario Amodei, wyraził wyraźne stanowisko podczas wywiadu dla CBS News, gdy zapytano go o wykorzystanie przez rząd modeli AI firmy. Opisał decyzję Departamentu Obrony o uznaniu Anthropic za „zagrożenie dla łańcucha dostaw" jako historycznie bezprecedensowy i karny ruch, argumentując, że ogranicza swobodę operacyjną wykonawcy w sposób, który może utrudniać innowacje. Sedno jego sprzeciwu jest proste: podczas gdy rząd USA dąży do wykorzystania AI w spektrum programów, pewne aplikacje—szczególnie masowa inwigilacja i w pełni autonomiczna broń—są niedostępne dla technologii Anthropic, przynajmniej w jej obecnej formie.

Amodei starał się rozróżnić między akceptowalnymi i nieakceptowalnymi zastosowaniami. Podkreślił, że firma wspiera większość rządowych przypadków użycia swoich modeli AI, pod warunkiem że te aplikacje nie naruszają swobód obywatelskich ani nie przekazują zbyt dużej władzy decyzyjnej maszynom. Jego uwagi podkreślają kluczowe rozróżnienie w debacie politycznej AI: granicę między umożliwianiem potężnej automatyzacji dla obrony a zachowaniem ludzkiej kontroli nad potencjalnie śmiertelnymi wynikami. Jego zdaniem ta ostatnia zasada jest fundamentalna dla wartości amerykańskich i norm międzynarodowych.

Oznaczenie Anthropic przez Departament Obrony zostało przedstawione przez Amodeiego jako papierek lakmusowy dla tego, jak USA zamierzają regulować szybko rozwijający się sektor technologiczny. Argumentował, że obecne prawo nie nadąża za przyspieszeniem AI, wzywając Kongres do wprowadzenia zabezpieczeń, które ograniczałyby krajowe wykorzystanie AI do inwigilacji, zapewniając jednocześnie, że systemy wojskowe zachowują konstrukcję z człowiekiem w pętli tam, gdzie to konieczne. Idea zabezpieczeń—mająca na celu zapewnienie jasnych granic dla programistów i użytkowników—rezonuje w branżach technologicznych, gdzie zarządzanie ryzykiem jest czynnikiem konkurencyjnym.

Tymczasem w tym samym tygodniu rozwinął się kontrastujący rozwój wydarzeń: OpenAI podobno zabezpieczył kontrakt z Departamentem Obrony na wdrożenie swoich modeli AI w sieciach wojskowych. Timing podsycił szerszą debatę o tym, czy rząd USA przyjmuje podejście wielodostawcowe do AI w obronie, czy też kieruje wykonawców w stronę preferowanego zestawu dostawców. Ogłoszenie OpenAI natychmiast przyciągnęło uwagę, a Sam Altman opublikował publiczne oświadczenie na X, co zwiększyło kontrolę nad tym, jak narzędzia AI będą zintegrowane z infrastrukturą bezpieczeństwa narodowego. Krytycy szybko wskazali na obawy dotyczące prywatności i swobód obywatelskich, argumentując, że rozszerzanie technologii zdolnej do inwigilacji w domenie obronnej grozi normalizacją inwazyjnych praktyk przetwarzania danych.

W trakcie publicznego dyskursu obserwatorzy branży zauważyli, że krajobraz polityczny jest nadal nieuregulowany. Podczas gdy niektórzy widzą możliwości dla AI w usprawnieniu operacji obronnych i poprawie cykli decyzyjnych, inni martwią się przekroczeniem uprawnień, brakiem przejrzystości i potencjałem niewłaściwie dopasowanych zachęt, gdy komercyjne firmy AI stają się integralne dla ekosystemów bezpieczeństwa narodowego. Zestawienie stanowiska Anthropic z sukcesem kontraktowym OpenAI służy jako mikrokosmos szerszych napięć w zarządzaniu AI: jak zrównoważyć innowacje, bezpieczeństwo i podstawowe prawa w świecie, w którym inteligencja maszynowa coraz bardziej stanowi podstawę krytycznych funkcji. Historia do tej pory sugeruje, że droga naprzód będzie zależeć nie tylko od przełomów technicznych, ale także od jasności legislacyjnej i pragmatyzmu regulacyjnego, które dostosowują zachęty w sektorach publicznym i prywatnym.

W miarę jak rozmowa polityczna trwa, interesariusze w świecie kryptowalut—gdzie prywatność danych, zgodność i zaufanie stanowią podstawę wielu ekosystemów—będą uważnie obserwować. Napięcie obronna-AI odbija się echem w technologii korporacyjnej, usługach chmurowych i rurociągach analitycznych, na których platformy kryptowalutowe polegają w zakresie zarządzania ryzykiem, narzędzi zgodności i przetwarzania danych w czasie rzeczywistym. Jeśli pojawią się zabezpieczenia z wyraźnymi ograniczeniami dotyczącymi zastosowań związanych z inwigilacją, implikacje mogą kaskadowo wpłynąć na sposób, w jaki narzędzia AI są sprzedawane do regulowanych sektorów, w tym finansów i aktywów cyfrowych, potencjalnie kształtując kolejną falę infrastruktury i narzędzi zarządzania opartych na AI.

Kluczowe pytania pozostają: Czy Kongres dostarczy konkretne ustawodawstwo definiujące akceptowalne użycie AI w programach rządowych? Jak ewoluują zamówienia DoD w odpowiedzi na konkurujące strategie dostawców? I jak nastroje publiczne ukształtują oceny ryzyka korporacyjnego dla dostawców AI, którzy działają w wrażliwych domenach? Nadchodzące miesiące prawdopodobnie ujawnią bardziej wyraźne ramy dla nadzoru AI, które mogą wpłynąć zarówno na politykę publiczną, jak i prywatne innowacje, z konsekwencjami dla programistów, wykonawców i użytkowników w całym krajobrazie technologicznym.

Ten artykuł został pierwotnie opublikowany jako Anthropic CEO Responds to Pentagon Ban on Military Use w Crypto Breaking News – Twoim zaufanym źródle wiadomości o kryptowalutach, wiadomości o Bitcoin i aktualizacji blockchain.

Możesz także polubić

Głosowanie Senatu nad Clarity Act zaplanowane na czwartek, gdy spór o zyski ze stablecoinów osiąga punkt wrzenia

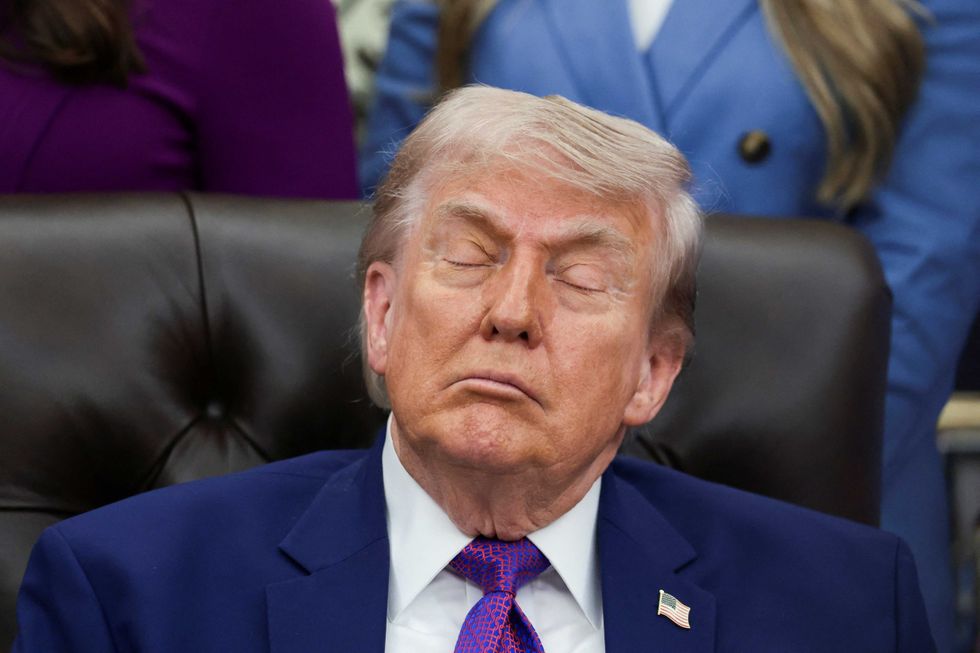

Eksperci medyczni wydają poważne ostrzeżenie dotyczące Trumpa w obliczu „gwałtownego pogorszenia": analityk