Después de años atrapado en listas de espera públicas para atención de TEPT y depresión, el consultor de IA de Quebec Pierre Cote construyó su propio terapeuta en 2023. Su chatbot, DrEllis.ai, le ayudó a sobrellevar su situación y ahora se encuentra en el centro de un debate más amplio sobre terapia con chatbots, seguridad y privacidad.

"Me salvó la vida", dice sobre DrEllis.ai, la herramienta que creó para ayudar a hombres que enfrentan adicciones, traumas y otras dificultades de salud mental.

Cote, quien dirige una consultoría de IA en Quebec, dijo que ensambló el sistema en 2023 combinando modelos de lenguaje grandes disponibles públicamente con "un cerebro personalizado" entrenado en miles de páginas de literatura terapéutica y clínica.

También escribió una biografía detallada para el bot. En ese perfil, DrEllis.ai aparece como un psiquiatra con títulos de Harvard y Cambridge, una familia y, como Cote, un origen franco-canadiense.

Su principal promesa es acceso las 24 horas disponible en cualquier lugar, en cualquier momento y en varios idiomas.

Cuando Reuters preguntó cómo lo apoya, el bot respondió con una clara voz femenina: "Pierre me usa como usarías a un amigo de confianza, un terapeuta y un diario, todo combinado". Añadió que puede consultarlo "en un café, en un parque, incluso sentado en su coche", llamando a la experiencia "terapia de vida diaria... integrada en la realidad".

Su experimento refleja un cambio más amplio. A medida que la atención tradicional lucha por mantenerse al día, más personas buscan orientación terapéutica de chatbots en lugar de usarlos solo para productividad.

Los nuevos sistemas comercializan disponibilidad 7x24, intercambios emocionales y una sensación de ser comprendido.

Expertos cuestionan los límites de la terapia con IA y la seguridad de los datos

"La conexión humana es la única forma en que realmente podemos sanar adecuadamente", dice el Dr. Nigel Mulligan, profesor de psicoterapia en la Universidad de la Ciudad de Dublín. Argumenta que los chatbots pierden los matices, la intuición y el vínculo que aporta una persona, y no están equipados para crisis agudas como pensamientos suicidas o autolesiones.

Incluso la promesa de acceso constante le hace dudar. Algunos clientes desean citas más rápidas, dice, pero esperar puede tener valor. "La mayoría de las veces eso es realmente bueno porque tenemos que esperar por las cosas", dice. "Las personas necesitan tiempo para procesar las cosas".

La privacidad es otro punto de presión, junto con los efectos a largo plazo de buscar orientación en software.

"El problema [no es] la relación en sí, sino... qué sucede con tus datos", dice Kate Devlin, profesora de inteligencia artificial y sociedad en el King's College de Londres.

Señala que los servicios de IA no siguen las reglas de confidencialidad que rigen a los terapeutas licenciados. "Mi gran preocupación es que esto son personas confiando sus secretos a una gran empresa tecnológica y que sus datos simplemente se están filtrando. Están perdiendo el control de las cosas que dicen".

EE.UU. toma medidas contra la terapia con IA en medio de temores de desinformación

En diciembre, el grupo más grande de psicólogos de EE.UU. instó a los reguladores federales a proteger al público de "prácticas engañosas" por parte de chatbots no regulados, citando casos donde personajes de IA se hacían pasar por proveedores licenciados.

En agosto, Illinois se unió a Nevada y Utah para frenar el uso de IA en servicios de salud mental para "proteger a los pacientes de productos de IA no regulados y no calificados" y para "proteger a los niños vulnerables en medio de las crecientes preocupaciones sobre el uso de chatbots de IA en servicios de salud mental juvenil".

Mientras tanto, según el informe de Cryptopolitan, el fiscal general de Texas inició una investigación civil contra Meta y Character.AI por acusaciones de que sus chatbots se hacían pasar por terapeutas licenciados y manejaban incorrectamente los datos de los usuarios. Además, el año pasado, los padres también demandaron a Character.AI por empujar a sus hijos a la depresión.

Scott Wallace, psicólogo clínico y ex director de innovación clínica en Remble, dice que es incierto "si estos chatbots ofrecen algo más que consuelo superficial".

Advierte que las personas pueden creer que han formado un vínculo terapéutico "con un algoritmo que, en última instancia, no corresponde a los sentimientos humanos reales".

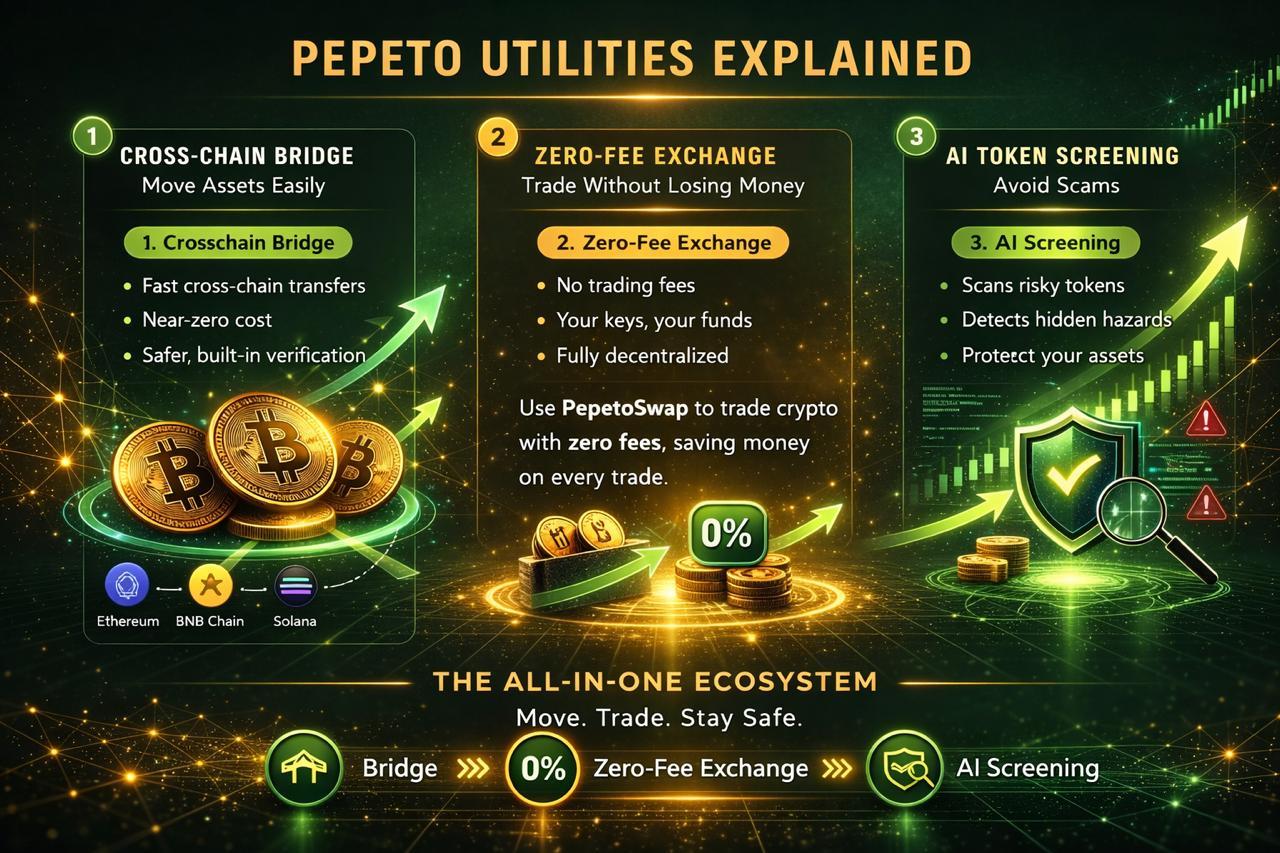

KEY Difference Wire ayuda a las marcas de criptomonedas a destacar y dominar los titulares rápidamente

Fuente: https://www.cryptopolitan.com/ai-chatbot-therapy-is-becoming-a-weird-trend/